Geoffrey Hinton cảnh báo AI phát triển quá nhanh có thể gây hậu quả nghiêm trọng nếu không kiểm soát chặt, ví như nuôi một con hổ con nguy hiểm.

Geoffrey Hinton

Geoffrey Hinton, nhà khoa học tiên phong trong lĩnh vực trí tuệ nhân tạo và từng là lãnh đạo cấp cao tại Google AI, đã đưa ra những cảnh báo nghiêm trọng về rủi ro khi AI phát triển không kiểm soát. Trong một cuộc phỏng vấn với CBS News, ông ví việc phát triển AI như nuôi một con hổ con – ban đầu có vẻ vô hại và dễ thương, nhưng càng lớn càng khó đoán và có thể trở thành mối đe dọa không thể kiểm soát nếu không được giám sát cẩn thận.

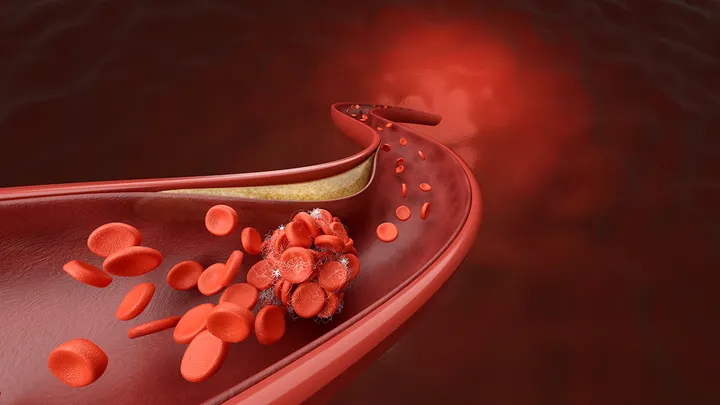

Theo Hinton, những hệ thống như ChatGPT, Copilot hay Gemini hiện nay tuy mang lại nhiều thành tựu đáng ghi nhận trong ngôn ngữ, lập trình và sáng tạo, nhưng bản chất vẫn là các mô hình học máy phức tạp mà con người chưa thể hiểu rõ. Chúng vận hành chủ yếu dựa vào xác suất thống kê và khối lượng dữ liệu khổng lồ, chứ không có khả năng nhận thức hay đạo đức như con người. Điều này làm dấy lên lo ngại khi AI được tích hợp vào các lĩnh vực then chốt như tài chính, y tế hoặc an ninh mạng – những nơi đòi hỏi mức độ tin cậy và kiểm soát cao.

Một trong những điểm đáng lo ngại mà Hinton nhấn mạnh là khả năng AI trở nên vượt ngoài tầm kiểm soát, với xác suất lên tới 10–20% theo ước tính của ông. Dù chưa thể dự đoán chính xác tương lai, nhưng tốc độ phát triển hiện tại của công nghệ này cho thấy rủi ro không còn là giả định. Trong môi trường thiếu giám sát và các tiêu chuẩn an toàn, các hệ thống AI có thể đưa ra hành vi không mong muốn hoặc bị lợi dụng cho mục đích xấu.

Hinton cũng cảnh báo về khả năng AI bị khai thác cho các hoạt động tấn công mạng tinh vi. Với khả năng phân tích và xử lý dữ liệu vượt trội, AI có thể bị lợi dụng để xâm nhập hệ thống ngân hàng, cơ sở hạ tầng y tế hay dữ liệu chính phủ. Dù AI cũng có tiềm năng hỗ trợ an ninh mạng và mã hóa, nhưng trong tay kẻ xấu, nó hoàn toàn có thể trở thành công cụ phá hoại nguy hiểm. Đây là nguy cơ mang tính hệ thống mà các nhà phát triển và cơ quan chức năng cần đặc biệt lưu tâm.

Không chỉ dừng lại ở kỹ thuật, Hinton còn phê phán mạnh mẽ các tập đoàn công nghệ lớn như OpenAI, Microsoft, Meta và Google vì đặt lợi nhuận lên trên sự an toàn của người dùng. Ông cũng chỉ ra khoảng trống nghiêm trọng trong chính sách, khi các quốc gia chưa có hành lang pháp lý cụ thể để kiểm soát sự phát triển của AI. Điều này tạo điều kiện cho một cuộc chạy đua công nghệ không kiểm soát, dẫn đến hệ quả là người dùng trở thành đối tượng chịu rủi ro cao nhất khi sử dụng các sản phẩm AI chưa được kiểm nghiệm đầy đủ về tính an toàn.

Sự lên tiếng của Hinton không chỉ dừng ở mặt lý thuyết. Năm 2023, ông đã chủ động từ chức tại Google để có thể công khai cảnh báo về các mối nguy của AI mà không chịu ảnh hưởng từ các cam kết lợi ích công ty. Ông nhấn mạnh rằng, dù AI có tiềm năng mang lại những đột phá vượt bậc cho loài người – từ chăm sóc sức khỏe đến cải thiện hiệu suất lao động – thì chúng ta vẫn cần nhìn nhận rõ ràng các rủi ro đi kèm. Với tốc độ phát triển chưa từng có trong lịch sử, AI đang đặt nhân loại vào một thời điểm mang tính bước ngoặt, đòi hỏi hành động kịp thời để bảo đảm công nghệ này phục vụ lợi ích chung thay vì trở thành mối đe dọa toàn cầu.